本期评述文章:

这篇论文的核心是利用高通量表型技术(比如无人机和三维成像)来精准地测量玉米雄穗的各种性状,然后结合基因组数据进行分析,从而挖掘控制这些关键性状的基因。

1.研究背景与意义

引言节选1

然而,大量个体表型性状的获取是当前制约分子育种效率的瓶颈,传统通过人工调查的手段由于效率低、投入大,难以大规模推广应用,特别是对作物变化较快的表型信息进行高通量获取时,往往是还未调查完,信息己经改变,最终导致调查数据不足,无法满足基因定位分析的需要,因此,高效获取作物表型高通量信息技术是实现基因挖掘的热点研究方向。

作者首先强调了玉米和优良种子的重要性,然后引出了现代的“分子育种”技术。

- 根据引言节选1,这项先进的育种技术目前面临着一个关键的“瓶颈”。你认为这个瓶颈具体是什么?

- 这个瓶颈是:大量个体表型性状的获取。

这个核心瓶颈就是表型信息的“高通量获取”——也就是如何快速、准确地测量大量作物的性状。传统的人工测量跟不上现代育种的需求。

这篇论文正是为了解决这个瓶颈,并选择了一个特定的器官来作为突破口。

引言节选2

玉米雄穗作为玉米主要的生殖器官,其形态学和发育表型分析是遗传育种和农业生产的重要环节。如图1-2所示,玉米雄穗主要由主穗和分枝构成,不同雄穗在主穗长度、分枝数量、分枝角度、分枝长度等特征上具有明显的区别,研究表明,玉米雄穗的结构与花粉产量和授粉效率直接相关,这不仅会影响最终的籽粒产量,还关乎自交系的留存[4]。然而,雄穗分枝过于密集以及雄穗尺寸过大并不会促进玉米的最终产量,反而会产生负面影响[5,6]。另一方面,抽雄进度的早晚,直接影响到玉米能否在最佳的时间进行授粉,进而影响到结实率和产量。

- 请你接着阅读引言节选2,找一找,为什么作者选择“玉米雄穗”作为研究的核心靶点?它对玉米的生长有什么关键影响?

- 玉米雄穗是玉米主要的生殖器官,其结构与花粉产量和授粉效率直接相关,这不仅会影响最终的籽粒产量,还关乎自交系的留存;此外抽雄进度的早晚,直接影响到玉米能否在最佳的时间进行授粉,进而影响到结实率和产量

你准确地抓住了玉米雄穗的两个关键作用:

- 形态结构 (morphology) 会影响花粉产量和授粉效率,进而影响产量 。

- 抽雄进度 (tasseling progress) 决定了授粉时机是否最佳,同样影响结实率和产量 。

- 既然人工观察这些性状很重要,那为什么还需要开发新技术呢?请结合引言节选3和摘要节选1的内容,总结一下传统的人工调查方法存在哪些主要的局限性?

- 人工调查存在主要局限性有:能调查的性状数量极为有限,现场调查方法效率较低,去雄不及时导致异花授粉的比例较低。

- 此外,与现实成本有关的是:成本高昂,严重制约了育种材料的筛选效率;与实验严谨测量准确性有关的是:雄穗在离开植株以后由于失水较快而导致其形态极易发生改变,人工测量不及时容易造成结果误差较大。

摘要节选1

玉米雄穗,作为玉米植株至关重要的生殖器官,其生长发育状态直接关系到玉米的产量与品质,是玉米育种研宄的核心靶点之一。在玉米育种实践中,由于育种材料数量庞大,且雄穗有效调查周期极为有限,传统依靠人工调查和测量的方式暴露出诸多弊端。这种方式不仅所能调查的性状数量极为有限,难以满足现代育种对多维度、高通量调查数据的需求,而且成本高昂,严重制约了育种材料的筛选效率,成为阻碍玉米育种进程的一大障碍。

引言节选3

除了玉米抽雄状态调查对育种意义重大之外,玉米雄穗穗型结构对产量和籽粒品质的形成也至关重要,因此对雄穗穗型结构的基因定位是当前玉米育种工作中一项热门的研宄方向,传统人工调查是一项高成本且复杂的工作,而且雄穗较弱,测量过程中容易发生折断现象,并且雄穗在离开植株以后由于失水较快而导致其形态极易发生改变,人工测量不及时容易造成结果误差较大,不仅如此,对于雄穗分枝角度、体积的测量依靠人工是很难完成的。

我们已经完整地勾勒出了这篇论文的研究动机。总结一下就是:

现代分子育种需要大量、精准的表型数据,但人工测量玉米雄穗(一个对产量至关重要的器官)存在效率低、成本高、数量有限、测量不准等诸多问题。这就为开发新技术提供了充分的理由。

既然我们已经清楚了“为什么”要研究,接下来,看看作者提出了什么样的技术方案来解决这些难题?我们可以深入探讨论文中提到的两种核心技术:

- 无人机图像识别:用于高通量地识别和计数大田里的玉米雄穗。

- 三维表型测量系统 (TIPS):用于精准地测量单个雄穗的复杂三维结构。

2.高通量表型获取技术

2.1无人机图像识别

我们先来看第一个技术:基于无人机图像的玉米雄穗识别。

这项技术的目的是解决前面提到的大规模普查效率低的问题。作者利用无人机拍摄大田照片,然后用计算机自动找出图片中的雄穗。

摘要节选2

本研究从两个关键维度展开深入探索,一是针对深度学习需要大量训练样本的难题创新性地运用迁移学习方法对无人机采集的高清数码图像中的玉米雄穗进行精准识别。实验结果表明,相较于未使用迁移学习的方法,基于迁移学习的FasterR-CNN、SSD、YOLO_X等算法在玉米雄穗检测效果上实现了较大精度的提升,其中,迁移学习后的YOLO_X算法表现最佳,识别精确度为96.15%,召回率为85.18%,准确度更是达到98.83%,为玉米雄穗的高效识别提供了可靠的技术方案。二是针对玉米抽雄初期小目标雄穗检测精度较低的行业难题,本研究通过优化RetinaNet模型结构并引入注意力机制的方式,实现对小目标雄穗的识别,结果显示,迁移学习模式下,改进的RetinaNet模型对小目标雄穗的识别精确度为99.01%,召回率为92.89%,平均精度98.83%,CNN、YOLO_X、SSD以及未改进的RetinaNet模型识别精度都要高,同时对比了改进的RetinaNet模型相较于其他模型,其识别精度更高。

- 为了实现自动识别,作者采用了“深度学习”的方法。请你看看上面的摘要节选2,找一找作者主要测试了哪几种深度学习模型?

- 作者主要测试的深度学习模型种类有:基于迁移学习的Faster R-CNN、SSD、YOLO_X,改进的RetinaNet模型,TreeQSM模型

Faster R-CNN、SSD、YOLO X 和 RetinaNet 确实是作者在这一部分重点研究的几种深度学习模型。

这里澄清两个小点:

- TreeQSM模型 我们稍后在讨论三维测量时会遇到,它主要是用来处理三维点云数据的,而不是识别二维图像。

- 你提到的“迁移学习” (transfer learning) 不是一种模型,而是一种非常聪明的训练方法。作者用它来提升前面几个模型(Faster R-CNN, SSD等)的识别精度。

作者在应用这些模型时,主要想解决两个行业内公认的难题。请你在摘要节选2里找一找,这两个难题分别是什么?

这两个难题就是:

- 样本数量:深度学习模型通常需要成千上万张标注好的图片才能训练好,这非常耗时耗力。

- 小目标检测:刚抽出来的雄穗很小,在复杂的农田背景下很难被准确发现。

我们先来看第一个难题——训练样本不够。作者提出了一个我们之前提到过的方法来解决这个问题。

- 请你在摘要节选2里找一找,作者具体运用了什么方法来解决“需要大量训练样本”的难题?

- 作者就是运用了“迁移学习” (transfer learning) 的方法。

你可以这样理解迁移学习:这就像一个已经学会了识别各种猫的AI,现在要教它识别老虎。因为它已经掌握了猫科动物的基本特征(比如胡须、耳朵、体型),所以它学习识别老虎会比从零开始快得多,也准得多。

在这篇论文里,作者先用一个公开的大型玉米雄穗数据集把模型训练好(学会“认猫”),然后把这个训练好的模型应用到自己采集的数据集上进行微调(学会“认虎”),从而解决了训练样本不足的问题。

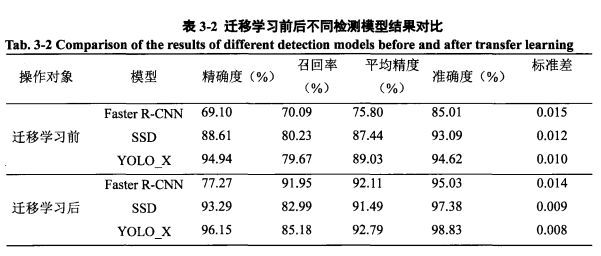

- 这个方法的效果非常显著。请你看一下论文中的 表3-2(上面),对比一下 YOLO_X 模型在使用“迁移学习”前后的“平均精度(%)”和“准确度(%)”有什么变化?

- 准确度从94.62%提升到了98.83% 。“平均精度”也从89.03%提升到了92.79% 。

这说明迁移学习让模型在识别的准确性和可靠性上都有了很大的进步,证明了这是一个非常有效的策略。

好了,解决了“样本数量”的问题,我们来看作者如何应对第二个难题:如何精准识别抽雄早期的“小目标雄穗”。

对于这个专门的问题,作者没有继续使用YOLO_X,而是选择并优化了另一个模型。请回到摘要(第5页),找一找作者选择了哪个模型,并对它做了哪些优化来实现对小目标的识别?

就是这两个关键点:优化模型结构 和 引入注意力机制。

简单来说:

- 优化模型结构(特别是特征金字塔网络FPN)就像是让模型学会同时使用“放大镜”和“望远镜”看图。它能更好地融合图像的细节信息(识别小目标需要)和整体轮廓信息(判断这是一个雄穗),从而看得更准。

- 引入注意力机制就像是给模型一个“聚光灯”。在复杂的背景(比如交错的叶子和土壤)中,它能让模型自动聚焦于最可能是雄穗的区域,而忽略掉无关的干扰信息。

所以,总结一下无人机识别这部分内容:为了解决训练样本不足的问题,作者使用了迁移学习;为了解决小目标识别难的问题,作者通过优化RetinaNet结构和引入注意力机制来提升精度。

我们已经了解了如何“识别和计数”雄穗,接下来,准备好进入下一个核心技术:TIPS系统,看看作者是如何“测量”雄穗复杂的三维结构!

2.2三维表型测量系统 (TIPS)

这项技术的目标是解决我们之前提到的“测量不准”的问题,特别是那些难以用手测量的三维性状,比如分枝角度和体积。

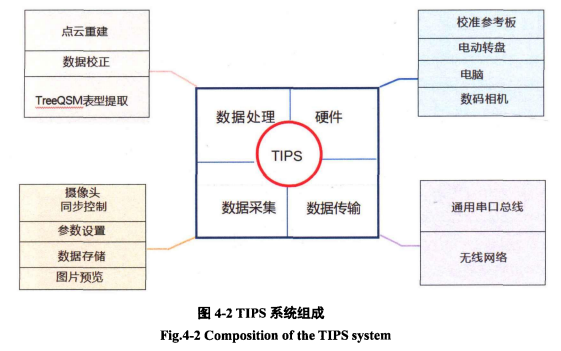

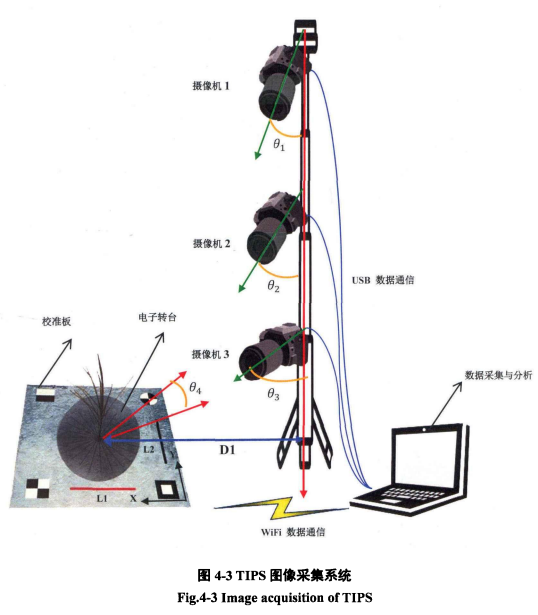

- 为了实现精准的三维测量,作者设计了一套自动化的图像采集设备。请你查看论文的 图4-2 和 图4-3,并结合文字描述,说一说这个TIPS系统的硬件主要由哪几个部分组成?它是如何采集一株雄穗的图像的?

- TIPS由校准参考板、电动转盘、一台电脑和三台数码相机组成,用三台摄像机设定固定的角度和高度来拍摄旋转到固定位置的雄穗的图像。

这个系统通过一个电动转盘旋转雄穗,再用三台不同角度的相机 📸 从多个视角拍摄一系列高清照片。

第四章节选1

基于TIPS获取的图像序列,应用SFM算法实现了每个玉米雄穗点云的三维重建。SFM依赖于多视图几何及运动恢复结构的基本原理[142],它从多幅图像重建3D模型,具有简单和环境限制小的优点[143]。Zhang等人[144]在用无人机获取图像后,使用SFM算法对人工林进行了3D重建,结果表明,该方法有效地描述了人工林的林下结构和厘米级尺度的植被,同时生成了大规模的点云模型。Sun等人[145]利用SFM重建了棉铃的三维结构,并通过点云聚类和分割的方法准确地确定了它们的数量和位置。Zermas等人[146]利用SFM重建玉米植株的点云,并通过分析其骨架结构来提取表型参数。SFM算法执行流程如图4-6所示。

- 系统采集了这么多二维(2D)照片之后,下一步就是要将它们转换成可以测量的三维(3D)形态。根据论文 4.1.4 点云重建(第四章节选1)部分的描述,这些大量的二维图像被用来生成一种什么样的数据?作者主要运用了哪种算法(SFM)来实现这个过程?

- 这些图像被用来生成每个玉米雄穗的3D模型,作者主要运用了SIFT算法来实现这个过程

这些二维图像确实是用来做三维重建的,生成的数据是一种叫做“3D点云” (3D point cloud) 的东西。你可以把它想象成一个由成千上万个精确的点组成的、悬浮在空中的雄穗三维骨架。

你提到的SIFT算法是这个过程的第一步,用来在不同照片中找到相同的特征点。而整个“从2D照片重建3D点云”的过程,作者称之为 SFM(运动恢复结构) 算法 。

第四章节选2

表型信息提取用到了TreeQSM算法和凸包算法,两者提取的指标如表4-5所示,其中TreeQSM算法已经被广泛应用在对树三维结构的提取上[149-152];并取得很好的效果,目前该算法己经被发布成不同版本软件[153-156],本文利用玉米雄穗与树结构相似的特点开展算法迁移应用。

现在我们得到了雄穗的“三维骨架”(点云),但还不知道它具体的尺寸。下一步就是从这个点云中提取出我们需要的表型数据,比如主穗长度、分枝数量等。

- 请你阅读 4.1.5 节(第四章节选2),作者主要使用了哪种算法来从点云中提取这些结构参数?

- 作者用了TreeQSM算法和凸包算法来从点云中提取这些结构参数。

理解这两个算法是掌握本章方法的关键。我们来分别解释一下。

2.2.1. TreeQSM 算法 (用于提取精细结构)

这个算法名字里有'Tree'(树)🌳,因为它最初是用来测量树木的。作者创新地把它用在了玉米雄穗上,因为它们结构相似(都有主干和分枝)。

你可以把它想象成用一堆小圆柱体来搭建雄穗的模型:

- 算法首先将点云“切片”,分成很多小段。

- 然后从柄部开始,沿着主穗向上“生长”,识别出哪些是主干,哪些是分枝。

- 最后,用一个个标准的圆柱体去拟合这些主干和分枝段。

一旦模型搭建完成,计算就很容易了:把主干上的所有圆柱体长度加起来就是“主穗长度”,数一数有多少个分枝圆柱体就是“分枝数”。它能重建出雄穗的内部“骨架”结构。

2.2.2. 凸包算法 (Convex hull) (用于测量整体轮廓)

这个算法要简单得多。你可以把它想象成用一个“保鲜膜”或橡皮筋把整个点云的最外围“包裹”起来,这个最小的、能包住所有点的外壳就是“凸包”。

这个“外壳”能告诉我们两件事:

- 凸包体积 (Crown Volume):整个雄穗占据的空间有多大。

- 冠层投影面积 (Crown Area):雄穗在地面上的“影子”有多大。

它描述的是雄穗的外部“轮廓”和大致体积。

- 理解了这两种算法后,你认为它们在描述雄穗形态时,提供的信息侧重点有什么不同?

- 一个像是“CT扫描”,另一个更像是“量三围”。

我们可以把这个区别再深化一下:

- TreeQSM 就像在做“CT扫描” 🔬,它能看透雄穗的内部,告诉你它的“骨架”是什么样的——主穗有多长、分了多少枝、每根分枝多长等等。它提供的是精细的、内部的结构信息。

- 凸包算法 更像是在量“三围” 📏,它只关心雄穗最外面的轮廓,告诉你把它装进一个最小的盒子里,这个盒子有多大(体积),以及它在地上的影子有多大(投影面积)。它提供的是整体的、外部的轮廓信息。

这两种信息互为补充,能更全面地描述一个雄穗的形态。

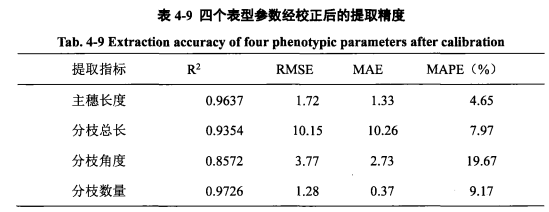

理解了方法之后,我们最关心的就是它的准确性。请你查看论文的 表4-9,看看作者用TIPS系统和TreeQSM算法提取出的“主穗长度”和“分枝数量”,与人工测量的真实值相比,它们的决定系数(R²)分别达到了多少?

(R²这个值越接近1,说明预测越准。)

特别是“分枝数量”(R² = 0.9726)和“主穗长度”(R² = 0.9637),这两个值的R²都超过了0.96,说明这个系统的测量结果和人工测量的结果高度一致,非常可靠。

很好!到现在为止,我们已经完整地学习了这篇论文提出的两大核心技术方案:

- 识别计数:通过 无人机 + 深度学习(迁移学习、优化RetinaNet)来解决。

- 三维测量:通过 TIPS系统(多视角拍照)+ SFM算法(生成点云)+ TreeQSM算法(提取参数)来解决。

既然作者已经有了快速、准确获取大量雄穗表型数据的方法,那么接下来的问题就是——用这些数据来做什么?

这就引出了论文的最终目的:利用表型数据进行基因挖掘和分析。让我们准备好进入论文的第5章和第6章,看看作者是如何应用这些数据的吧~

3.基因挖掘分析

作者手握海量的雄穗表型数据,首先做了一项很有创意的分析:基于雄穗的三维表型进行材料分型(第5章)。

在育种中,玉米材料通常会被分为几个不同的“类型”(比如文中的NSS, TST, SS),不同类型有不同的优缺点,育种家需要知道材料的类型来进行杂交。传统上,确定一个玉米的类型需要复杂的分子标记(基因检测),成本很高。

因此,作者提出了一个问题:我们能不能“以貌取人”,仅通过测量雄穗的三维形态,就预测出它属于哪种基因类型呢?

第五章节选1

雄穗结构表型参数通常用作候选基因挖掘,本章内容主要是通过提取的玉米雄穗结构表型大数据,将其与玉米材料分型信息进行聚类分析,解决传统利用多态性分析标记方法过程复杂的问题,表型结构参数提取利用的是第四章中TIPS系统完成的,最后利用高斯模糊聚类的方法实现了对材料分型的预测。

- 请你阅读第5章的引言(第五章节选1),作者想通过这种“看形态、猜类型”的方法,解决传统分类方法中的什么具体问题?

- 解决传统利用多态性分析标记方法过程复杂的问题

传统用基因检测(分子标记)的方法来分类,过程复杂、成本又高。作者就是想探索一个更高效、经济的替代方案。

为了实现这个目标,作者首先用TIPS系统测量了1194个雄穗的11种不同结构参数(比如主穗长度、分枝数、柄直径等),然后将这些数据输入一个特定的算法,让算法根据这些形态参数自动“聚类”或“分组”。

请你在第5章的引言(第五章节选1)中找一找,作者主要使用了哪种聚类算法来给这些雄穗进行分组?

这个算法的特点是“模糊”,也就是说,它在分类时不是简单地把一个雄穗100%划归为A类或B类,而是会给出一个概率,比如“这个雄穗有70%的可能是NSS类型,有30%的可能是TST类型”。这很符合生物性状的复杂性。

摘要节选3

其中,NSS分型的预测精确度达到67.7%,召回率70.86%,TST分型的预测精确度达到78.5%,召回率74.05%

- 那么,这个“看形态、猜类型”的方法效果如何呢?请你在摘要的同一段落(摘要节选3)找一找,利用10个表型参数进行聚类后,模型对 NSS 分型和 TST 分型的预测精确度分别达到了多少?

- NSS达到67.7%,TST达到78.5%

虽然不是100%,但这证明了仅通过雄穗的外部形态来预测其基因类型是有可行性的,这本身就是一个非常有价值的发现,为育种家提供了一个快速、低成本的初筛方法。

在完成了“分型”之后,作者在第6章做了更深入的分析:关键性状基因挖掘。他利用了更强大的 GWAS(全基因组关联分析) 方法,将“主穗长度”、“分枝数”等具体的表型数据与264万个基因位点进行关联,最终成功锁定了几个最有可能控制这些性状的候选基因。

我们来完整地回顾一下这个“故事”:

- 发现问题:人工测量玉米雄穗太慢、太贵、不准,跟不上现代育种的需求。

- 提出宏观方案:用无人机拍照,再通过深度学习模型(如优化后的RetinaNet)进行大范围的自动识别和计数。

- 提出微观方案:设计TIPS系统(转盘+相机),将拍下的照片用SFM算法合成为3D点云,再用TreeQSM等算法从中提取出精准的三维表型数据。

- 数据应用1(分类):将提取的表型数据输入GFC聚类算法,实现了对玉米材料的快速分型预测。

- 数据应用2(挖基因):将关键的表型数据(如分枝数)与基因组数据进行GWAS关联分析,最终成功锁定了控制这些性状的候选基因。

微信扫描下方的二维码阅读本文